生成AI活用に求められる「アジャイル・ガバナンス」の重要性

【弁護士/スマートガバナンス 代表取締役共同創業者 落合 孝文氏】

【弁護士/スマートガバナンス 代表取締役CEO 羽深 宏樹氏】

博報堂DYホールディングスは生成AIがもたらす変化の見立てを、「AI の変化」、「産業・経済の変化」、「人間・社会の変化」 の3つのテーマに分類。各専門分野に精通した有識者との対談を通して、生成AIの可能性や未来を探求していく連載企画をお送りします。

第7回は「AIガバナンス」をテーマに、今後生成AIを活用するうえで求められるガバナンスや仕組みづくりで注意すべき点について、渥美坂井法律事務所・外国法共同事業 弁護士の落合 孝文氏、スマートガバナンス株式会社 代表取締役CEO・弁護士の羽深 宏樹氏のお二人に、生成AIも含めた先進技術普及における社会的枠組みの整備・事業活用に多くの知見を持つクロサカ タツヤ氏とともに、博報堂DYホールディングスの西村が話を伺いました。

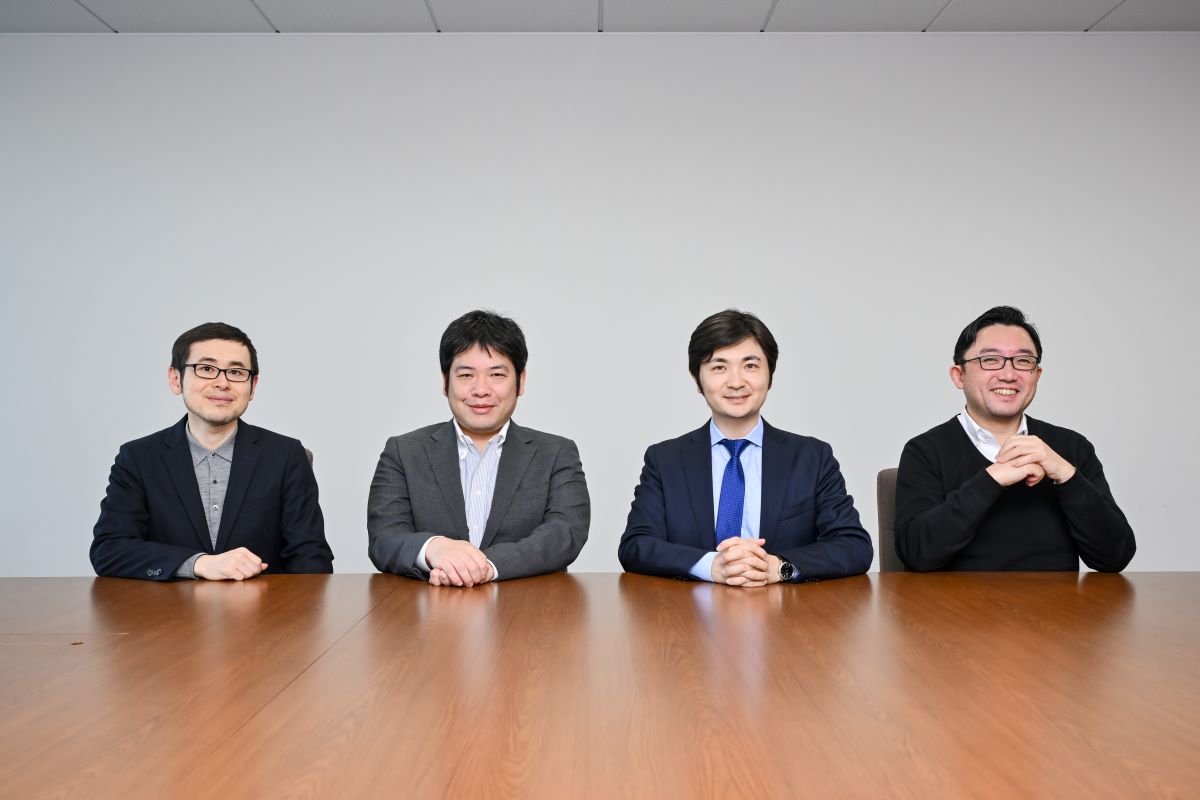

(写真右から)

クロサカ タツヤ氏

慶應義塾大学大学院政策・メディア研究科 特任准教授

株式会社 企(くわだて) 代表取締役

羽深 宏樹氏

スマートガバナンス株式会社 代表取締役CEO

京都大学大学院法学研究科特任教授・弁護士

落合 孝文氏

渥美坂井法律事務所・外国法共同事業 シニアパートナー弁護士

プロトタイプ政策研究所 所長

スマートガバナンス株式会社代表取締役共同創業者

西村 啓太

博報堂DYホールディングス

マーケティング・テクノロジー・センター 室長代理

株式会社Data EX Platform 取締役COO

生成AIの“無限定”性がもたらす2つのリスク

西村

今回は、イノベーションの社会実装に向けたガバナンスのコンサルティング等を行うスマートガバナンスの代表であり弁護士である羽深さんと落合さんに、「AIガバナンス」をテーマにお話を伺えればと思います。お二人は、それぞれ経産省と総務省で、「AI事業者ガイドライン」策定のワーキンググループのメンバーも務められています。まずは行政、企業などさまざまな主体が生成AIを活用していく際に想定される懸念やリスクについて、お二人の意見をお聞かせください。

羽深

生成AIは、従来型のAIのようにディープラーニング技術をベースにしていますが、リスクの観点からは異なる部分もあります。大きく違う点としてまず一つ目は、「使用目的が無限定であること」です。これまでのAIも、「予測不可能性」や「説明不可能性」などガバナンス上の問題点が指摘されてきましたが、とはいえ例えば自動運転システムが誰かの誹謗中傷をすることはないですし、顔認識システムが架空の顔画像を創作することもない。それが、昨今の生成AIでは、文章の生成のみならず画像や動画の生成を含めて、あらゆる場面に適応可能になりました。つまり、ひとつの基盤モデルのリスクシナリオが無限に広がる状況になってきたのだと言えます。

そして二つ目が、「ユーザー側も無限定であること」です。これまでは、AIを活用してアクションを起こしていく場合、それができるのはごく一部の限られたエンジニアだけでした。しかし、自然言語を通じたインターフェースやプロンプトが用意されている生成AIでは、誰もが簡単に使えるようになったのです。そうなると、従来型の特定の目的に使うAIのように、主にエンジニアを中心にリスク管理を行っていくアプローチが通用しなくなってくる。AIを使って、「どこで、誰が、何をするのかわからなくなる」ということですね。そうなると、組織マネジメントの観点からも問題になってきますし、社会一般でどういったリスクが出てくるのかを事前に特定しておくことが、非常に困難になるわけです。

西村

確かに生成AIはガバナンスの対象が広がりすぎてしまっていて、ルールや仕組みに落とし込む上での難しさがありますよね。さらに、生成AIのアウトプットに対する著作権の問題やプライバシーのリスクも考えられます。

羽深

生成AIのリスクは、大きく分けて「生成AIの技術的限界によるリスク」と「生成AIが優秀すぎるがゆえに生じてしまう社会的なリスク」という二つの側面があると思っています。技術的限界に由来するリスクとしては、ハルシネーション(事実と異なる回答)やプロンプトインジェクション(悪意のあるプロンプト入力によって不適切な回答が出てしまうこと)の問題などが挙げられます。社会的なリスクの典型例は、フェイクコンテンツです。あまりに本物そっくりのコンテンツを作り出せてしまうがために、個人の尊厳や民主主義に害が及ぶ可能性も指摘されています。特に2024年は米国や欧州はじめ世界各地で重要な選挙が行われるので、フェイクコンテンツが社会に与えるリスクは大きな注目を集めています。また、著作権を含む知的財産の問題も非常に大きいです。少し前まで、まさかAIが、人間が作ったものと区別できないようなコンテンツを作れるようになるとは、誰も想定していませんでした。現在、著作権法の解釈を巡って大きな議論が巻き起こっていますが、既存社会の枠組みの中で作られた法と照らし合わせどう判断していくかというだけでなく、社会の前提が変わったことを踏まえて「ルールを作り直す」ところまで踏み込んで議論する必要があると感じています。