そんな中、博報堂DYグループは“人間中心のAI技術”を軸に研究開発を行う組織「Human-Centered AI Institute」を設立しました。

AI技術のさらなる進化が加速する今、AIをどう活用すべきか。

そして、どのようなリスク対策が求められているのか。

本記事では、先日開催した博報堂DYグループが主催する“生活者データ・ドリブン”マーケティングセミナー「進化し続けるAIと人間中心のアプローチ:AI技術・ガバナンスの最新トレンド」の様子を編集してお届けます。セミナーレポート記事の後編として、デロイト トーマツ リスクアドバイザリー合同会社の山本優樹氏より、AI規制やガバナンスに関する最新動向を解説いただきます。さらに、最新技術トレンドや企業が今取り組むべきリスク対策について、山本氏と森がパネルディスカッションした様子をご紹介します。前編では、「Human-Centered AI Institute」の代表を務める森正弥が、AIの技術的な進化の方向性や人間中心のAI活用のアプローチについて触れながら、博報堂DYグループの今後のAI活用の取り組みについてご紹介しています。前編はこちら。

<登壇者>

山本 優樹氏

デロイト トーマツ リスクアドバイザリー合同会社

デロイトアナリティクス シニアマネジャー

森 正弥

博報堂DYホールディングス執行役員 Chief AI Officer

Human-Centered AI Institute代表

【第二部】AI規制・ガバナンスの最新動向とAIリスク対策

AI活用によって起こりうるリスクとは

山本

はじめに、私のプロフィールを簡単に紹介させてください。

もともと私は、日本のテック系企業の研究部門に10数年所属し、さまざまな製品やサービスにおけるAI・機械学習の技術開発に携わってきました。その後、デトロイト トーマツ グループに参画後は、AI技術のビジネス導入とリスク対策について、クライアント企業様のお手伝いをさせていただいています。

では、AI活用に伴うリスクについてお話させていただきます。

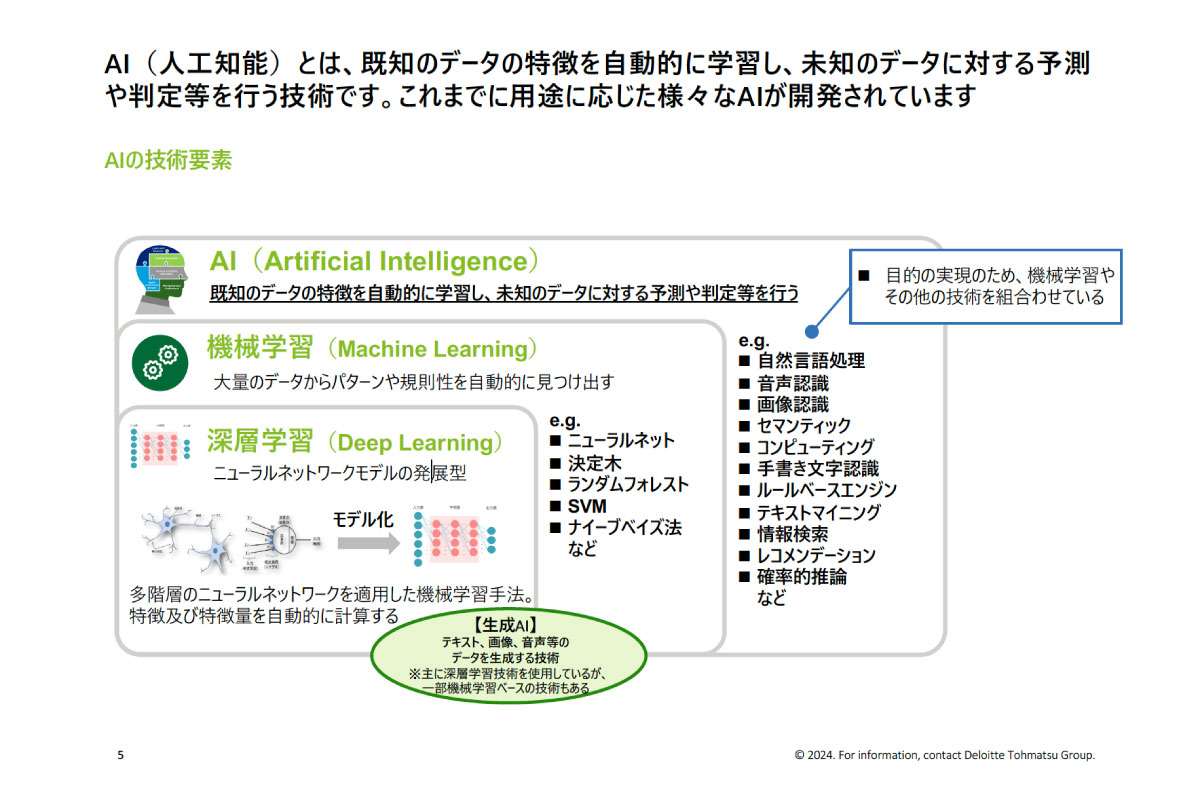

AIとは、簡単に言えば人間の知性をコンピュータで実現する取り組みのこと。大量のデータをAIに与えることで、データの特徴を学習させ、再表現させる技術として確立されてきました。

こうしたことから、データさえあれば、さまざまな領域でAIを活用できる可能性があります。

たとえば、製造業や金融業、流通業など、各業界で独自の活用がなされてきましたし、業界に限らず、経営やマーケティング、人材領域でも活用が進められてきました。

ただ、「データの特徴を学習する」といった特徴は、これまでの「人間がつくったルールに従わせる」技術と比べると、いろんなリスクが発生するおそれがあります。

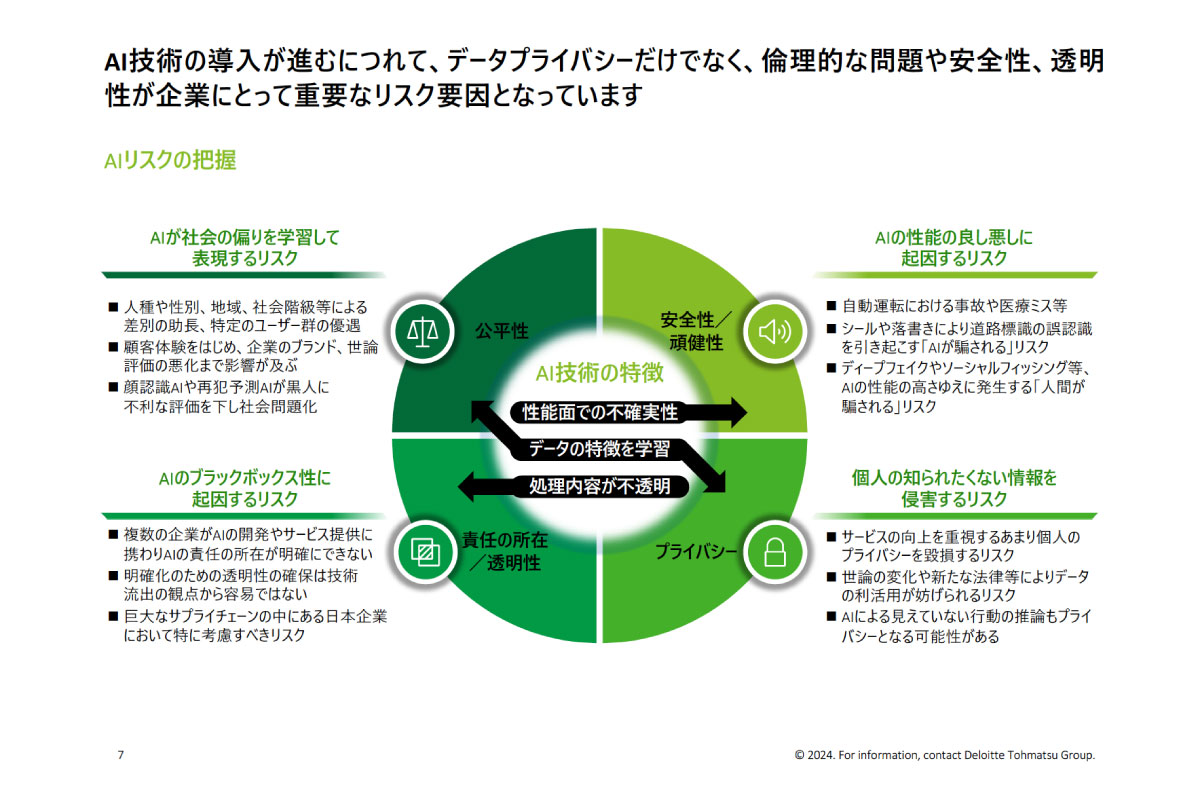

どのようなリスクが発生しうるのか、3つ挙げさせていただきます。

● 性能面の不確実性に起因するリスク

AIは、原理的に100%の性能を発揮することが難しい不確実性を持った技術です。そのため、自動運転における事故や医療ミスなど、安全性・頑健性の面でリスクが発生する可能性があります。

● データの特徴を学習することによるリスク

たとえば、学習させるデータがなんらかの不公平や不平等性を持っていた場合、再表現時に、AIが不公平な判断をしてしまう可能性も。さらに、サービス向上を目指すあまり、本来与えてはならないデータ、具体的には個人情報などをAIに与えてしまうと、プライバシーの侵害につながるリスクもあります。

● 処理内容の不透明さによるリスク

最近は生成AIの処理が急速に複雑化しており、いかに優れた研究者であっても、実際にどんな処理が行われているのかわからないようなブラックボックス化が進んでいます。そのため、AIが何を根拠に回答を生成しているかといったことを明確にできない説明性に関するリスクや、AIに関する責任の所在を明確にできないというリスクもあるでしょう。

AIのリスクの特徴として、以上お話しした「リスクの多様さ」に加え、「リスクの影響範囲の広さ」「リスク対策のルールがあいまい」といった3つが主に挙げられます。